Cet article est également disponible en:

Anglais

En décembre, nous évoquions la colère de nombreux artistes face à la plateforme Artstation et sa politique concernant les images créées à l’aide d’IA. Une ces causes principales de ce mouvement : l’aspect éthique et le fait que de nombreux outils s’appuyant sur l’intelligence artificielle ont été entraînés, affinés à l’aide de données récupérées sur internet sans l’accord des artistes, ni rétribution.

IA et NVIDIA

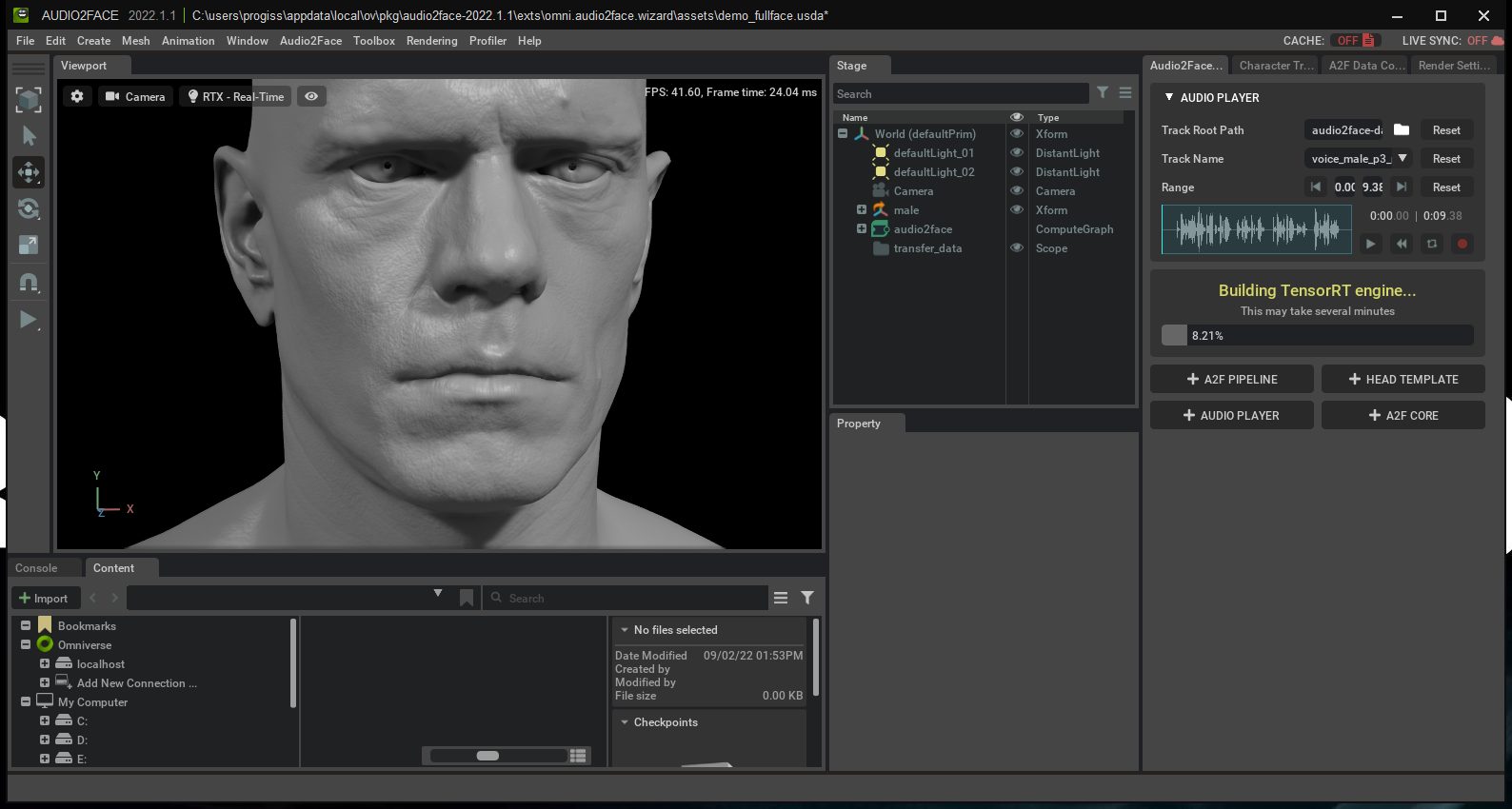

En parallèle, NVIDIA met justement en avant des outils s’appuyant sur l’intelligence artificielle au sein d’Omniverse, sa plateforme de conception 3D et collaboration. On pense par exemple ici à Audio2Face qui permet d’animer des visages de personnages 3D à partir d’un enregistrement audio, à l’outil Canvas qui transforme des esquisses basiques en paysages haute résolution. Plus globalement, NVIDIA a multiplié les projets impliquant de l’IA et se tourne clairement vers ces technologies pour son avenir.

Dès lors, la question se pose : comment sont entraînés les outils de NVIDIA, et quelle est la position de l’entreprise sur l’origine des fameux datasets, les ensembles de données utilisés pour entraîner les IA ?

Nous avons profité d’une conférence de presse pour poser directement la question à NVIDIA, qui nous a donné quelques précisions.

Les droits des artistes, une priorité

NVIDIA nous a indiqué, en substance, qu’elle prend cette question très au sérieux. L’entreprise veut « veiller à « s’assurer ce que seuls des éléments pouvant faire l’objet d’une license d’utilisation soient employés » dans ses projets.

Le groupe ajoute qu’il s’agira d’un travail de longue haleine, mais que sa priorité reste le respect des droits des artistes.

NVIDIA nous a aussi donné un exemple de cette implication en aval : non pas dans la création des données utilisées pour entraîner les IA, mais dans la détection des médias créés par IA. NVIDIA participe en effet au programme SemaFor du DARPA (agence du département de la Défense des USA qui fait de la R&D autour des nouvelles technologies). Le but de SemaFor : développer des outils automatisés pour aider les analystes à détecter les médias manipulés par intelligence artificielle, comme les deepfakes créés à l’aide de StyleGAN3 de NVIDIA.

Une réflexion globale à poursuivre dans l’industrie créative

Ces sujets avaient aussi été évoqués lors des RADI-RAF, en fin d’année à Angoulême, par deux entreprises s’intéressant aux IA. La vidéo de cette conférence est visible plus bas.

Kinetix (qui travaille sur de l’animation à partir de vidéos), dans les questions/réponses (13:40 dans la vidéo), soulignait que le paysage législatif serait sans doute amené à évoluer et que la question du transfert de propriété/des droits entre les datasets et les éléments produits par les IA posaient question.

Henri Mirande (CTO – Kinetix) a indiqué que Kinetix entraîne ses outils uniquement sur des datasets dont l’entreprise possède un droit d’usage commercial, ou qu’elle possède directement. Comme l’indique Henri Mirande, il s’agit aussi pour Kinetix d’anticiper les évolutions légales : une entreprise qui entraînerait ses IA sur des données publiques sans vérifier leur origine risque de rencontrer des problèmes majeur en cas de nouvelle loi stricte.

Du côté de Golaem, spécialiste de la simulation de foules, le positionnement est différent mais tout aussi intéressant. Le CEO Stéphane Donikian présentait ici des travaux mêlant IA et rig pour la simulation de foules. A 18:25 dans la vidéo, il indique que l’idée est de permettre aux studios d’entraîner les outils avec leurs propres données, sans que celles-ci ne soient utilisées par d’autres.

Des réponses qui montrent que les entreprises sont conscientes des enjeux. On peut donc espérer qu’à côté des approches vues comme prédatrices, des fonctionnement plus vertueux se généralisent. Nous suivrons évidemment de près les annonces sur ce sujet.

01:52 – Kinetix

05:30 – usages créatifs des IA

09:14 – prévisions, l’avenir des IA

13:40 – Q&A Kinetix (enjeux légaux, droit d’auteur)

15:31 – Golaem

15:54 – présentation

16:43 – deep learning et foule: pourquoi?

18:10 – Body Deformer: IA & rig

18:25 – qui possède les données?

19:06 – démo – rig de corps

19:25 – démo – rig facial

22:18 – workflow

23:08 – WIP, appel à studios, avenir

26:01 – Q&A Golaem